Ложное обвинение: ИИ против человека

Лента новостей

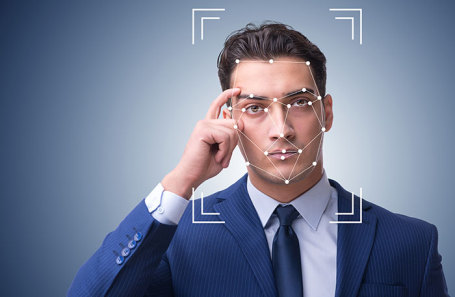

Что делать, если искусственный интеллект принимает обычного гражданина за преступника

Будущее человечества — за машинным интеллектом. Уже сейчас есть системы, которые облегчают нам жизнь и делают ее безопаснее. Но они допускают ошибки. Иногда — с весьма неприятными последствиями.

Человек имеет право на ошибку, а алгоритм — нет? Что делать, если искусственный интеллект принимает вас за другого и этот другой — преступник?

Не так давно интернет взбудоражила история 18-летнего американца. Его задержали по подозрению в кражах из магазинов Apple. На него указала система распознавания лиц, используемая в магазинах компании. Но она ошиблась: у юноши есть стопроцентное алиби на время одной из краж, в которой его обвинили. Теперь американец требует взыскать с Apple ни много ни мало 1 млрд долларов.

Как такое вообще могло произойти? Мы обратились за комментарием к Аркадию Сандлеру, руководителю Центра искусственного интеллекта МТС, где разрабатываются инновационные решения для бизнеса и внедряются технологии искусственного интеллекта в цифровые продукты.

Аркадий Сандлер руководитель Центра искусственного интеллекта МТС «Системы распознавания лиц имеют высокую корректность. Допустим, с вероятностью 98% они дают правильные предсказания, что это именно этот человек. Но этому прекрасному джентльмену посчастливилось попасть в оставшиеся 2%. Система ошиблась. Точно так же, и даже с большей долей вероятности, мог бы ошибиться охранник. Представьте себе, в магазине Apple на входе стоит охранник, каждое утро ему показывают набор фотографий людей, которые, предположительно, своровали что-то в Apple. Если он увидит этого человека на входе — его нужно задержать и вызвать полицию. Охранник видит некоего человека, ему кажется, что он видел сегодня утром фотографию этого человека, задерживает его, вызывает полицию, дальше идет разбирательство. Выясняется, что у человека есть алиби. Что произойдет? Перед человеком извинятся. Может быть, предложат какой-нибудь купон в качестве извинения. Но нет же предположения, что этот человек так сильно обидится, что потребует 1 млрд долларов за ошибку охранника».

Во всем мире, включая Россию, возникает все больше мест, где внедряются системы распознавания лиц. Это магазины, банки, общественный транспорт. Идентификация лиц применяется в смартфонах для разблокировки и в мобильных приложениях для подтверждения операций.

В ретейле применение таких технологий становится обычной практикой. Каждый магазин может вести черный список клиентов, которые совершали у них кражи, чтобы узнавать их еще при входе. Но это не единственный сценарий применения технологий распознавания образов. Еще одна решаемая сегодня задача — сбор информации для клиентской аналитики. Например, магазин может разработать новые программы лояльности для постоянных покупателей или удобнее расположить товары на полках.

Идентификация лиц может сделать удобнее и безопаснее общественный транспорт. Также технология активно применяется для создания развлекательных приложений — вспомните «маски» в Facebook, Instagram или мессенджерах. Сервисы по поиску двойников также применяют такие технологии.

В общем, у медали, как обычно, две стороны: когда технологии работают так, как им положено, польза от них весьма ощутима. Но любая программа может допустить ошибку. А значит, кто-то должен нести за это ответственность. Об этом — в нашем следующем материале.

Рекомендуем:

Рекомендуем: